AI a praca licencjacka – dlaczego ChatGPT Cię nie nauczy pisać (i co to znaczy dla Twojej obrony)

ChatGPT napisze Ci pracę licencjacką w cztery godziny. Brzmi jak rozwiązanie wszystkich problemów, aż do momentu, gdy promotor na obronie zadaje pytanie, o tekst na które student nie zna odpowiedzi. I zapada ta niezręczna cisza.

Nie chodzi o to, że AI jest złe. Nie możesz zdelegować myślenia. Ważne jest abyś zrozumiał zagadnienie, o którym piszesz. I właśnie temu warto przyjrzeć się z bliska — szczególnie jeśli właśnie piszesz pracę licencjacką lub planujesz to zrobić.

Czym jest cognitive offloading i dlaczego dotyczy każdego studenta

Kiedy wsiadasz do auta i włączasz nawigację, nie uczysz się drogi. Delegujesz myślenie do urządzenia i to jest dokładnie to, co naukowcy nazywają cognitive offloading, czyli delegowaniem procesów poznawczych do narzędzi zewnętrznych.

W przypadku jazdy samochodem to całkowicie racjonalne. Nie po to jedziesz do Warszawy, żeby zapamiętać trasę na mapie. Ale jeśli Twoim celem jest nauczenie się czegoś — napisanie pracy licencjackiej, zrozumienie tematu, zbudowanie własnego argumentu — to oddanie tego procesu AI jest jak wożenie się taksówką z nadzieją, że nauczysz się prowadzić.

Efekt? Masz wynik. Nie masz wiedzy.

Co dzieje się w mózgu, gdy ChatGPT pisze za Ciebie – badania EEG

W 2024 roku ukazało się badanie, które zmierzyło dosłownie za pomocą EEG, czyli elektroencefalografii — co dzieje się w mózgach studentów piszących eseje w trzech warunkach: z pomocą ChatGPT, z pomocą wyszukiwarki internetowej i bez żadnej technologii.

Wyniki były jednoznaczne.

Grupa ChatGPT wykazała najsłabsze wzorce połączeń między neuronami ze wszystkich trzech grup. Co więcej, studenci z tej grupy mieli poważne trudności z przypomnieniem sobie lub cytowaniem treści eseju, który właśnie „napisali”. Tekst istniał. Wiedza — nie.

Badanie ujawniło jeszcze jeden niepokojący efekt: studenci korzystający z AI zgłaszali mniejsze poczucie własności swojej pracy. Wiedzieli, że to nie ich słowa. Wiedzieli, że to nie ich myślenie. I ta świadomość — albo jej brak — ma poważne konsekwencje dla całego procesu uczenia się.

„The Memory Paradox” — dlaczego wiedza w głowie jest niezastąpiona

W maju 2024 roku Barbara Oakley i Terence Sejnowski — twórcy jednego z najpopularniejszych kursów o uczeniu się na świecie, „Learning How to Learn” dostępnego na Coursera — opublikowali artykuł pod tytułem The Memory Paradox: Why Our Brains Need Knowledge in the Age of AI.

Ich główna teza brzmi tak: poprzez wyszukiwanie i praktyczne używanie wiedzy, ta wiedza z czasem staje się automatyczna i tworzy mentalne ramy, które wspierają efektywne myślenie. A poleganie na narzędziach zewnętrznych — takich jak ChatGPT — sprawia, że omijamy ten proces.

Rezultat jest paradoksalny. Masz dostęp do nieskończonej ilości informacji. Ale bez zinternalizowanej wiedzy własnej nie jesteś w stanie z tych informacji skorzystać. Nie dostrzegasz błędów. Nie adaptujesz treści. Nie możesz nic z nimi zrobić — bo nie masz do czego ich odnieść.

Pisanie pracy licencjackiej to jeden z tych momentów, kiedy ten paradoks uderza ze szczególną siłą. Masz gotowy tekst. Ale na obronie musisz myśleć.

Iluzja mistrzostwa — wiesz, że napisałeś. Nie wiesz, że się nie nauczyłeś.

To jeden z najgroźniejszych efektów korzystania z AI przy pisaniu prac — bo jest niewidoczny.

Student, który korzystał z ChatGPT przy pisaniu pracy, czuje, że rozumie temat. W końcu przeczytał gotowy tekst, prawda? Sprawdził go, może poprawił kilka zdań. Ale to poczucie rozumienia bez rzeczywistego rozumienia — właśnie to naukowcy nazywają iluzją mistrzostwa lub iluzją kompetencji.

Badanie Bastaniego z 2024 roku (Generative AI Can Harm Learning) pokazuje coś, co powinno dać do myślenia każdemu studentowi: studenci, którym odebrano dostęp do AI po długim korzystaniu z niej, osiągali gorsze wyniki niż ci, którzy nigdy z niej nie korzystali. Nie tyle samo, co przed użyciem. Gorsze. Generatywna AI może dosłownie — w sensie mierzalnym — upośledzić proces uczenia się.

Mechanizm jest prosty. Każdy raz, kiedy zamiast myśleć, klikasz „generuj” — unikasz wysiłku. A bez wysiłku nie ma uczenia się. Uczenie musi boleć. To nie metafora — to neurobiologia.

Kiedy rzeczywistość weryfikuje iluzję — przypadek z polskiej sali egzaminacyjnej

To nie jest problem abstrakcyjny ani wyłącznie zagraniczny. Polska wykładowczyni akademicka, opisała na LinkedIn doświadczenie, które powinno dać do myślenia każdemu studentowi piszącemu pracę z pomocą AI.

Oblała 40% swoich studentów i studentek.

Nie dlatego, że nie byli zdolni. Dlatego, że na egzaminie nie potrafili obronić ani jednego zdania z własnej pracy. Tekst był — wiedzę zastąpiła cisza.

Ale to nie był koniec odkrycia. Przy okazji wyszło coś głębszego: znaczna część studentów nie przyznała się do korzystania z AI, nawet gdy było to ewidentne. Szli w zaparte. Unikali wzięcia odpowiedzialności za treść, którą złożyli pod własnym nazwiskiem.

To nie jest problem techniczny, który rozwiąże lepszy antyplagiat. To problem kultury — kultury szukania drogi na skróty i unikania odpowiedzialności za efekty własnych decyzji. I jest to problem, który uderza rykoszetem — bo na obronie nie ma już drogi na skróty. Jest komisja, pytanie i Ty.

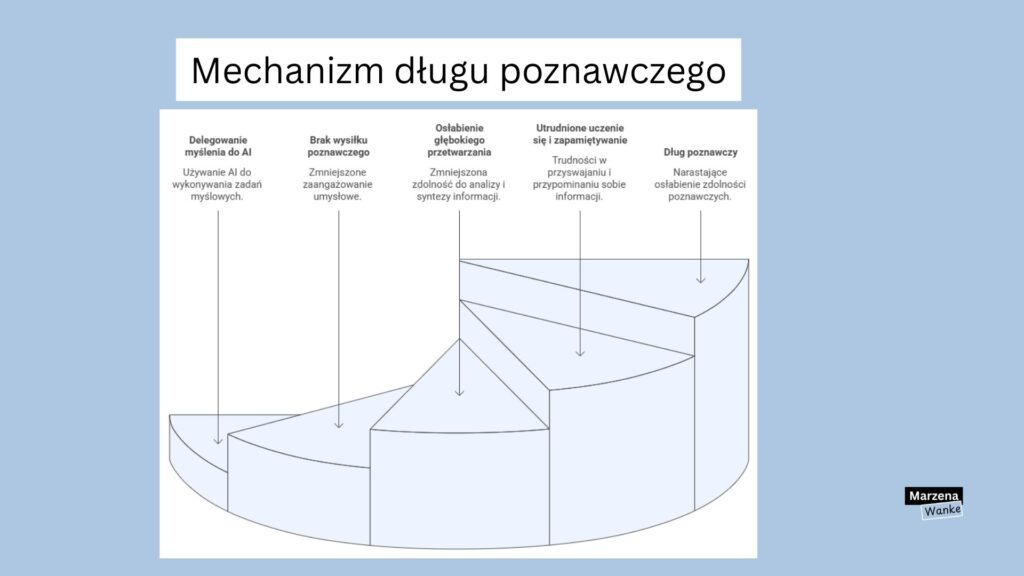

Dług poznawczy — ciche zagrożenie, którego nie widać na papierze

Psycholodzy mówią o zjawisku długu poznawczego (cognitive debt). Polega ono na tym, że kiedy systematycznie unikamy aktywnego zaangażowania poznawczego — bo AI robi to za nas — osłabiamy zdolność do głębokiego myślenia i głębokiego przetwarzania informacji.

Efekt nie jest natychmiastowy. Narasta powoli, jak odsetki od nieuregulowanego kredytu. Po miesiącu, dwóch, semestrze — nagle okazuje się, że coraz trudniej zacząć cokolwiek samodzielnie. Że pojawia się niepokój, gdy nie ma dostępu do narzędzia. Że każde zadanie wymagające własnej analizy wywołuje opór.

Na obronie pracy licencjackiej ten dług trzeba spłacić jednorazowo — bez możliwości rozłożenia na raty.

Rusztowanie mentalne — kiedy AI buduje je za wcześnie

Oakley i Sejnowski używają w swoim artykule pojęcia mentalnego rusztowania. Chodzi o struktury myślowe, które budujemy w głowie, gdy uczymy się czegoś od podstaw — przez wysiłek, powtarzanie, popełnianie błędów i ich korygowanie.

Problem pojawia się, gdy generatywna AI tworzy to rusztowanie za wcześnie.

Wyobraź sobie studenta pierwszego roku, który nie ma jeszcze żadnej wiedzy z danej dziedziny. Zamiast przez tygodnie budować własne rozumienie — pyta ChatGPT, dostaje gotową odpowiedź i uznaje temat za opanowany. Rusztowanie zostało postawione przez maszynę. Ale to nie jego rusztowanie. Nie trzyma żadnego jego budynku.

Kiedy promotor zapyta na obronie: „Dlaczego wybrał Pan/Pani taką metodologię?” — rusztowanie runie. Bo nigdy nie było zbudowane przez właściciela.

Jak ujmuje to wymaganie wobec każdej pracy dyplomowej w Polsce Sławomir Byłeń: „praca musi być samodzielna, czyli powinna stanowić istotny wkład własnej pracy piszącego, a nie być tylko kompilacją zebranych materiałów źródłowych” (Byłeń, Metodyka pisania pracy dyplomowej, s. 85). To wymóg formalny. Ale jest też wymóg głębszy — własna praca to jedyny sposób, żeby rzeczywiście czegoś się nauczyć.

Apple, wielkie modele językowe i „The Illusion of Thinking”

Wiosną 2025 roku Apple opublikował raport pod wymownym tytułem The Illusion of Thinking. Jego główne przesłanie jest takie: duże modele językowe nie myślą. Symulują myślenie. Są wyrafinowanymi maszynami do przewidywania następnego słowa na podstawie wzorców statystycznych.

Kiedy piszesz prompt i dostajesz odpowiedź — nie rozmawiasz z ekspertem. Rozmawiasz z bardzo zaawansowanym wzorcem językowym, który nie rozumie nic z tego, co pisze.

Dla pisania pracy licencjackiej ma to bardzo konkretne konsekwencje. AI może wyprodukować tekst, który wygląda na akademicki. Może użyć właściwych pojęć, odpowiednich struktur zdaniowych, nawet trafnych źródeł (choć tu zdarza się halucynować). Ale nie może zrozumieć Twojego tematu. Nie może zadać trafnego pytania badawczego. Nie może ocenić, czy Twoja argumentacja jest spójna.

To możesz zrobić tylko Ty — jeśli masz wiedzę. I tylko ją zbudujesz przez własną pracę.

Ogródek, firma ogrodnicza i praca licencjacka — analogia, która wszystko wyjaśnia

Wyobraź sobie, że masz ogródek. Możesz zadzwonić do firmy, która go posprząta, posadzi kwiaty i będzie regularnie pielęgnować. Ogródek będzie piękny. Nikt nie zaprzeczy.

Ale jest jeden problem: to nie jest Twój ogródek. Nie wiesz, co w nim rośnie. Nie wiesz, jak o to dbać. Nie czujesz satysfakcji z pracy.

Właśnie tak wygląda praca licencjacka napisana przez AI. Ładny ogródek. Cudzy. Bez Ciebie w środku.

A promotor na obronie nie pyta o ogródek. Pyta o Ciebie w ogródku. O to, co robiłeś, dlaczego to robiłeś i czego się przez to nauczyłeś.

Jeśli oceniasz wyłącznie efekt — piękny ogródek — nie dziw się, że studenci wynajmują firmy ogrodnicze. Ale jeśli ważny jest proces — kopanie, pielęgnowanie, uczenie się — to praca musi być Twoja. Nie da się tego obejść bez oszukiwania przede wszystkim siebie.

AI w pisaniu pracy licencjackiej — co naprawdę pomaga, a co szkodzi

Nie chodzi o to, żeby całkowicie wykluczyć AI z procesu pisania pracy. Chodzi o to, żeby wiedzieć, kiedy i jak z niego korzystać.

AI jako narzędzie weryfikacji — tak:

- Czy w moim rozdziale brakuje jakiegoś ważnego wątku?

- Sprawdź spójność terminologiczną w tym akapicie

- Czy ta definicja jest poprawna według aktualnej literatury?

- Pomóż mi sformułować to zdanie jaśniej

AI jako mózg zastępczy — nie:

- Napisz mi wstęp do pracy o zarządzaniu ryzykiem

- Streść tę teorię i podaj jej zastosowania

- Wygeneruj hipotezy badawcze do mojej pracy

- Opisz wyniki badań ankietowych

Różnica jest prosta: w pierwszym przypadku myślisz Ty, AI weryfikuje. W drugim myśli AI, Ty klikasz „kopiuj”.

Jeśli nie wiesz, od których narzędzi zacząć i jak je dopasować do konkretnego etapu pisania — sprawdź Narzędziownik studenta: 24 sprawdzone narzędzia na 12 etapów pisania pracy licencjackiej i magisterskiej — od znalezienia literatury po sprawdzenie plagiatu. Każde z konkretną wskazówką jak używać go wspierająco, nie zastępczo.

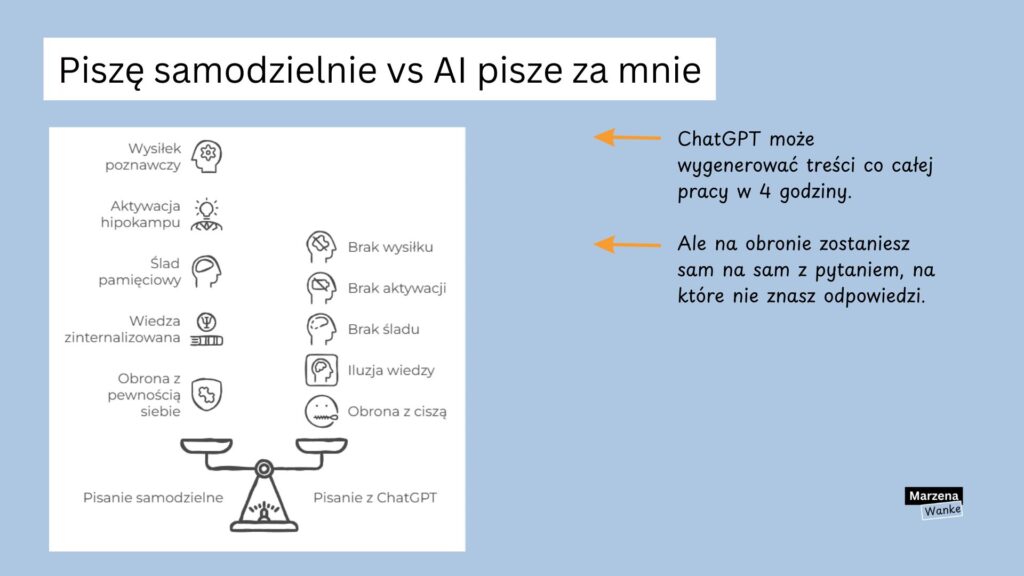

Wyniki badań EEG pokazują zresztą coś ciekawego: studenci, którzy najpierw pisali samodzielnie, a dopiero potem korzystali z LLM, wykazywali znaczny wzrost połączeń mózgowych w porównaniu z grupą, która zaczęła od AI. Kolejność ma znaczenie. Twój mózg najpierw, narzędzie potem.

Promotor to rozpozna — efekt homogenizacji

Jest jeszcze jeden efekt, o którym rzadko mówi się wprost, a który ma bardzo praktyczne konsekwencje: eseje i prace pisane z pomocą ChatGPT są do siebie uderzająco podobne.

Badanie EEG z 2024 roku, które porównywało trzy grupy piszących studentów, odnotowało to jednoznacznie: prace z grupy ChatGPT charakteryzowały się jednolitą strukturą, powtarzającymi się frazami i niską zmiennością językową. Innymi słowy — brakiem głosu autora.

Promotorzy i recenzenci czytający dziesiątki prac w semestrze ten wzorzec rozpoznają. Nie zawsze mają narzędzie, żeby to udowodnić. Ale widzą. I zadają pytania na obronie — właśnie tam, gdzie Twój „własny głos” musi nagle się pojawić.

Tip: Jeśli czytasz swój tekst i nie słyszysz w nim siebie — to sygnał ostrzegawczy. Własna praca ma własny rytm, własne wątpliwości, własne błędy. AI tego nie symuluje. Generuje poprawność. A poprawność bez głosu autora brzmi pusto.

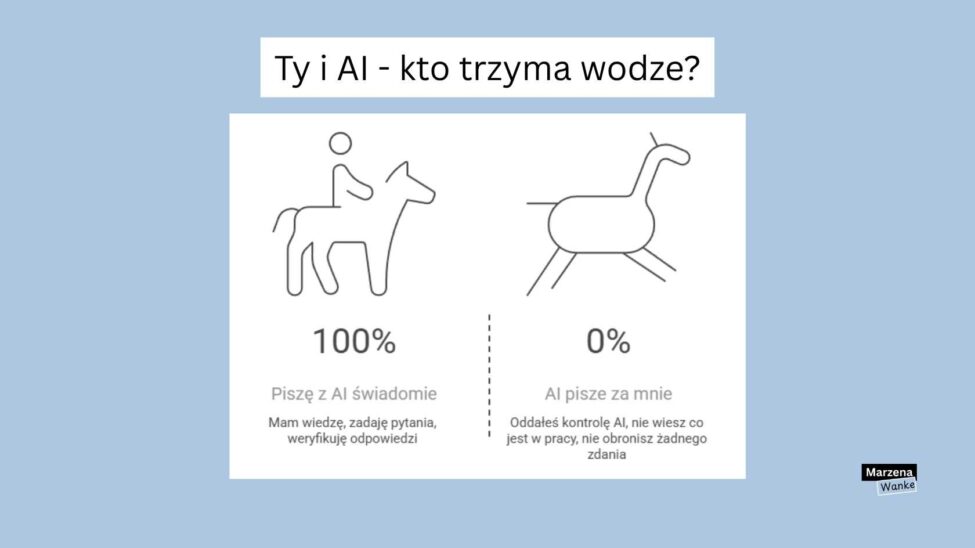

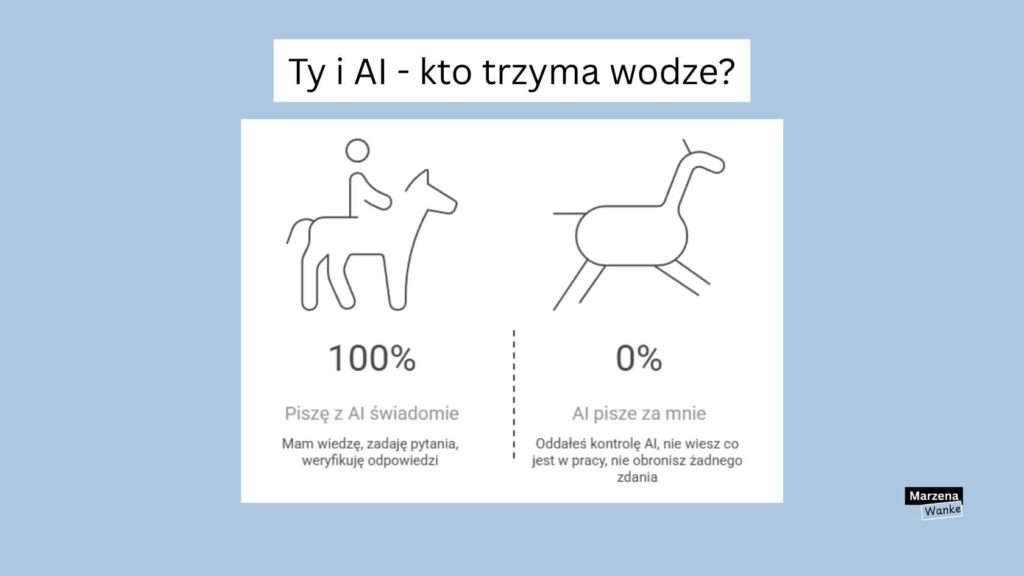

Jesteś jeźdźcem. AI to koń. Trzymaj wodze.

Jeden z najlepszych obrazów, jaki można przytoczyć w kontekście korzystania z AI w edukacji, jest prosty: jesteś jeźdźcem, AI to szybki koń. Naprawdę szybki. Może zanieść Cię bardzo daleko. Ale tylko wtedy, gdy trzymasz wodze.

Jeśli oddasz kontrolę — koń poniesie Cię tam, gdzie chce. Albo wyrzuci Cię w połowie drogi, jeśli nie umiesz jeździć.

Praca licencjacka to Twoja jazda. AI może Ci pomóc jechać szybciej. Ale siodło musisz mieć na sobie. I musisz wiedzieć, dokąd jedziesz.

Kontrola bez odpowiedzialności nie istnieje

Jest jeszcze jedna rzecz, o której warto powiedzieć wprost: możesz oddać AI kontrolę nad pisaniem. Możesz pozwolić mu generować rozdziały, hipotezy, wnioski. Ale odpowiedzialności oddać nie możesz.

Na obronie komisja nie przyjmuje „ChatGPT mi to napisał” jako wyjaśnienia. Praca nosi Twoje imię i nazwisko. Podpisałeś oświadczenie o samodzielności. Promotor i recenzent oceniają Ciebie — nie narzędzie, którego użyłeś.

To jak wynająć firmę budowlaną do postawienia domu i stanąć przed komisją odbioru technicznego z wyjaśnieniem, że nie wiesz, gdzie są instalacje. Dom stoi pod Twoim adresem. Odpowiedzialność też.

Jeźdźca można zrzucić z siodła. Właściciela — nie.

Jak pisać pracę licencjacką, żeby naprawdę ją rozumieć — 5 zasad

Nie ma jednej magicznej metody. Są za to sprawdzone sposoby pisania pracy licencjackiej i magisterskiej, które działają – zarówno z AI, jak i bez.

1. Zacznij od własnej analizy. Zanim otworzysz jakiekolwiek narzędzie, napisz ręcznie, co wiesz o temacie i jakie masz pytania. Kartka papieru, długopis. Hipokamp dziękuje za pisanie ręczne – aktywuje procesy, które prowadzą do zapamiętywania.

2. Stwórz konspekt sam. Układ rozdziałów, pytania badawcze, hipotezy – to musi być Twoja praca. AI może potem sprawdzić, czy czegoś nie przeoczyłeś. Ale architektura pracy jest fundamentem Twoich kompetencji.

3. Pisz rozdziały metodą „najpierw sam, potem AI”. Napisz wersję roboczą własnoręcznie. Potem poproś AI o feedback. Zidentyfikuj różnice. Wróć do własnej wersji z nową wiedzą. W tej kolejności połączenia neuronowe rzeczywiście powstają.

4. Bądź w stanie obronić każde zdanie. To praktyczny test. Jeśli nie możesz wytłumaczyć, dlaczego dane zdanie jest w Twojej pracy i co znaczy – to zdanie nie powinno tam być.

5. Prowadź dziennik refleksji. Notuj, gdzie AI Ci pomogła, a gdzie przeszkadzała. Gdzie narzuciła styl, który nie był Twój. Gdzie dała błędną informację. To nie tylko dobra praktyka — to też budowanie świadomości własnego procesu myślenia.

Nie wiesz, jakich narzędzi użyć do researchu i budowania struktury, żeby nie stracić głowy w dziesiątkach aplikacji? Narzędziownik studenta przeprowadzi Cię krok po kroku — od pierwszego pomysłu do obrony.

Karta autorefleksji — 6 pytań, które student powinien sobie zadać

Zanim oddasz pracę promotorowi, zadaj sobie te pytania. Nie promotorowi. Sobie. Szczerze.

1. Czy sięgnąłem po AI zanim samodzielnie spróbowałem rozwiązać problem? Jeśli tak — dlaczego? Co by się stało, gdybym najpierw napisał własną wersję?

2. Czy potrafię własnymi słowami wyjaśnić każdy akapit tej pracy? Nie odtworzyć z pamięci — wyjaśnić. Komuś, kto nie zna tematu.

3. Czy rozpoznaję miejsca, gdzie AI narzuciła mi styl lub słownictwo, które nie jest moje? Jeśli tekst brzmi bardziej „jak artykuł z encyklopedii” niż jak Ty — wiesz, skąd to pochodzi.

4. Czy odczuwam niepokój na myśl o wykonaniu kolejnego zadania bez AI? To ważne pytanie. Nie o lenistwo — o zależność. Jeśli odpowiedź brzmi „tak” — warto się nad tym zatrzymać.

5. Czy potrafię odróżnić swoje myślenie od myślenia wygenerowanego przez narzędzie? W pracy, którą oddajesz pod własnym nazwiskiem, powinna być widoczna granica. Jeśli jej nie widzisz — komisja też jej nie zobaczy. Ale zadane pytania tę granicę odsłonią.

6. Co zrobiłem z pracą, czego AI nie mogłoby zrobić za mnie? To jest pytanie o Twój wkład. O Twoje pytanie badawcze, Twoją interpretację wyników, Twój wniosek. Jeśli nie masz odpowiedzi — wróć do pracy, zanim trafi do dziekanatu.

Podsumowanie — praca licencjacka to nie tekst do wygenerowania, to dowód na Twoje poznanie badanego tematu

Praca licencjacka to nie dokument do złożenia w dziekanacie. To dowód — że przez kilka miesięcy naprawdę pracowałeś, analizowałeś, rozumowałeś i wyciągałeś wnioski. Że potrafisz myśleć w danej dziedzinie.

Jeśli ChatGPT pisał zamiast Ciebie — masz papier. Nie masz dowodu.

Na obronie komisja nie ocenia ogródka. Ocenia Ciebie w ogródku.

Warto to wiedzieć, zanim usłyszysz pytanie i zostanie cisza.

Potrzebujesz pomocy z pracą licencjacką, która naprawdę będzie Twoja? Sprawdź, jak możemy wesprzeć Cię na każdym etapie — od konspektu po redakcję końcową — tak, żebyś na obronie był pewny każdego zdania.

FAQ — najczęściej zadawane pytania o AI i pracę licencjacką

Czy można w ogóle używać AI przy pisaniu pracy licencjackiej? Tak — jeśli używasz go jako narzędzia weryfikacji, a nie generatora treści. AI może sprawdzić spójność terminologiczną, zasugerować literaturę, wskazać luki w argumentacji. Nie może jednak zastąpić Twojego myślenia, analizy i własnych wniosków — a właśnie to ocenia komisja na obronie.

Czy antyplagiat wykryje pracę napisaną przez ChatGPT? Coraz częściej — tak. Systemy antyplagiatowe są stale rozwijane o moduły wykrywające treści generowane przez AI. Ale antyplagiat to najmniejszy problem. Promotor zadający pytania na obronie jest skuteczniejszy niż jakikolwiek algorytm.

Co grozi za napisanie pracy licencjackiej przez AI? Formalnie — skreślenie z listy studentów, unieważnienie egzaminu dyplomowego, w skrajnych przypadkach konsekwencje dyscyplinarne. Nieformalnie — brak wiedzy i kompetencji, które praca miała potwierdzać. To drugie jest dotkliwsze długoterminowo.

Ile czasu zajmuje napisanie pracy licencjackiej bez AI? Tyle samo co zawsze — kilka miesięcy. Ale ten czas to nie strata. To budowanie kompetencji, które zostają po obronie. AI skraca czas. Nie skraca procesu uczenia się — bo ten można jedynie pominąć. A pominięty proces to dług, który spłacasz całą karierą zawodową.

Jak sprawdzić, czy moja praca jest rzeczywiście moja? Zadaj sobie jedno pytanie: czy jesteś w stanie wytłumaczyć każde zdanie w pracy własnymi słowami, bez zaglądania do tekstu? Jeśli tak — praca jest Twoja. Jeśli nie — wiesz, co trzeba poprawić, zanim trafi do promotora.

Potrzebujesz pomocy z pracą licencjacką, która naprawdę będzie Twoja? Zacznij od narzędzi — Narzędziownik studenta zbiera 24 sprawdzone aplikacje na każdy etap pisania, z konkretną wskazówką jak każdego używać mądrze. Zero zgadywania.

Źródła:

- Bastani, H. (2024). Generative AI Can Harm Learning. The Wharton School, University of Pennsylvania.

- Oakley, B., Sejnowski, T. (2024). The Memory Paradox: Why Our Brains Need Knowledge in the Age of AI.

- Apple Research (2025). The Illusion of Thinking.

- Byłeń, S. Metodyka pisania pracy dyplomowej na kierunku logistyka. SAN, Łódź, s. 85.

- Badanie EEG trzech grup (ChatGPT / wyszukiwarka / bez technologii), 2024 — analiza wzorców połączeń neuronowych podczas pisania esejów.